試すだけだったはずの画像生成AI(Diffusion Bee)だけど、思った以上にハマってしまった。初期の頃は大量にグロ画像を生成する羽目になったけど、あれから勉強を重ねてそれなりにマトモな絵を生成できるようになってきた。ということで今回はDiffusion Beeで綺麗な美少女を生成するために試してみたことを記事にしたい。Stable Diffusion系の画像生成AIを試している人の参考になれば嬉しい。

絵のクオリティを上げるために試したこと

カスタムモデルの導入

デフォルトのモデルだと安定したクオリティの美少女を生成するのが難しいということで、カスタムモデルの導入を行った。今回は二次元イラストの生成に特化したカスタムモデルとして、Waifu Diffusionを導入してみた。

このサイトの、Float 16 EMA Prunedからカスタムモデルをダウンロードした。

設定の変更

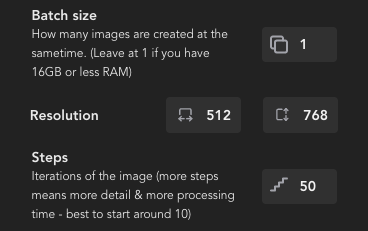

設定の項目も変更した。

まずは正方形に近いよりも縦長にしたほうが形が崩れにくくなると考えて、初期状態の512×512から768×512に解像度を変更。正方形だと別のキャラが不完全な形で描画されたり、キャラの造形が崩壊してしまう事が多かった。

Step(AIに絵を学習させる回数)もデフォルトの25から50に増やした。学習回数を増やせば増やすほど生成にかかる時間も増加する。パソコンの性能とも相談しよう。

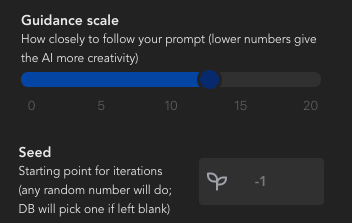

もう一つ、Guildance Scale(AIにどの程度自由に描かせるかを決める、低いほど自由)も初期状態の7から10前半ぐらいに引き上げる。これでより安定した絵が出力できる。はず。

プロンプト(呪文)を改良

何よりもAIに命令する文章は改良しなければいけない。

呪文の改良にあたっては下記のサイトを参考にさせていただいた。先人達に感謝。

具体的な改良方法

具体的にどうやって呪文を改良したか。前述のサイトの記述をパクリ、もとい参考にした結果、

- まず機械的にクオリティを上げるためのテンプレ呪文を入力する。

- その後にキャラの属性、着ている服、身体的特徴を入力。

- ネガティブプロンプト除外したい要素を弾く。

- 特に手や指は崩れたり変な形で描画されやすいので念入りに打ち消す。

- 基本的に前の呪文ほど優先されやすく、(((呪文)))とするとその内容をさらに強調できる。

これらを意識して呪文の改良を実施した。

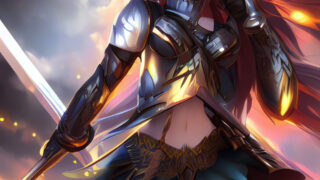

実際に出力できたイラスト

そんな改良の末に実際に生成した美少女達がこちら。

一方で初期の頃の絵がこちら。

確かにクオリティは向上したと思うんだけど、いかにもAIが書いたという感じの、良くも悪くも量産型美少女アニメ絵と化した。もう少しちゃんと人間が描いた感じの、上手く言葉で言い表せないんだけどそういう雰囲気が出せればなと思う。

それから英語はもう少しちゃんと勉強しておけば良かった。命令分は英語で記述する以上、英語がマトモに理解できないとかなり厳しい。今は中学生未満の拙い英語力とGoogle翻訳で頑張ってるけど、本格的にAI絵を使って自由自在に絵を作るなら英語の勉強は必要不可欠だね。

また何か進歩があれば記事にします。

続編です。

コメント